有一次,我和一个圈外的朋友聊起了自动驾驶,一个不算“太新”的词。“自动驾驶?至少10年。” 这是从他口中说出的答案。这也从另一个层面反映出,还有很多人对自动驾驶,甚至是辅助驾驶还不太了解。

所以,我想如果有机会,我想用最简单的话跟大家聊一聊目前自动驾驶的进程,而这回避不了的就是当下炙手可热的“激光雷达”。

首先,我们来看看自动驾驶的三个基本要素:感知-决策-执行。感知层是整个自动驾驶漏斗的最顶层。感知是否准确,对后续的决策和执行起着决定性的作用。

在这里,您可以在大脑中构图。对于500度近视的人来说,开车戴眼镜还是不戴眼镜是一个质的区别,这就是“感知层”的重要性。

激光雷达就是为了解决这个问题。它的重要性不仅在于给机器戴上“近视眼镜”,还在于戴上这些眼镜。机器能感知的世界不仅能看得更远,还能“360度无死角”。

为什么我们需要激光雷达

在之前的自动驾驶市场,高端玩家包括谷歌Waymo、Cruise、百度Apollo。对于这些科技巨头来说,他们的收入不是卖汽车,而是卖系统和解决方案。

因此,他们的首要任务是先把“成品”做好,也就是说,他们可以不计成本地通过堆叠BOM来实现自动驾驶。

对于“脚踏实地”的乘用车市场,采用科技巨头的结果只会是:生产出来的汽车要么卖天价,要么亏本卖,这被视为慈善机构。而商业化是他们要考虑的更多。

换句话说,他们想做的是一辆对大多数人来说有利可图且负担得起的汽车。因此,成本更低的毫米波雷达+摄像头融合方案成为了他们的首选,也就是我们经常听到的L2级辅助驾驶。

这种组合的能力上限并不高,很难实现真正意义上的自动驾驶。主要原因是感知能力不够。说白了就是机器对世界的理解不够清晰。

先说毫米波雷达。它的主要功能是测距、速度和方位角。原理是不断地发射和接收电磁波,通过计算发射和返回的时间差来实现测距功能,通过多普勒效应计算返回接收天线的雷达波的频率变化来实现测速,然后通过接收反射的电磁波相位差计算方位角。.

在这里,你可以拼出靠墙打乒乓球的画面。毫米波雷达的原理是通过计算乒乓球运动的轨迹来计算人与墙的距离、乒乓球的速度、人与墙的距离。角度差。

但是,毫米波雷达有很多缺点。例如,毫米波雷达即使配备了仰角天线,也无法感知高度。例如,如果毫米波雷达安装在前保险杠中,如果障碍物在空中是水平的,那么毫米波雷达用于监控。不,因为高度不一致。

当然,这只是一个缺点。还有一点就是道路上的大部分物体都会产生回波,所以毫米波雷达在算法中必须过滤掉静止物体产生的回波。比如在弯道中,如果前面有电线杆,毫米波雷达感应到电线杆的回波会被判断为前方有障碍物,并采取刹车动作,造成奇怪的现象。 “鬼制动”行为。这就是为什么毫米波雷达几乎没有能力识别静止物体的原因。

此外,毫米波雷达不会对透明物体产生回波,例如“水滴”。这会让机器误认为是“无止境的路”,直接导致下雨天的感知准确率下降。

说完毫米波,再来说说相机。

首先,傻机器一定没有联想能力,所以它无法理解视频的含义。但它可以理解图片,因为它使用了人工智能中的图像识别。其原理是机器将视频分割成图片,然后将图片拉到最大,从最原始的“pixel-part-whole”三个步骤识别它是什么。

中间少不了“算法逻辑”,它告诉机器它是什么,然后对图片进行分类,这样下次机器就可以知道它是什么了。

举个简单的例子,看着这个大灯,我就知道是宝马 5 系。为什么我知道是5系?因为我看到的第一个,第二个我的大脑判断它为5系列。

所以问题来了。首先,如果这5系变白了,我相信我还是知道的,但是机器呢?二是假设现在有一辆奥迪A4L,机器能识别吗?

答案是一个知道,另一个不知道。

先说第一个,因为深度学习中的卷积神经网络。简单来说,我不是通过颜色来区分是不是5系,而是通过更核心的“灯”来区分。卷积神经网络就是将图片划分为多个像素区域并进行分类。如果有匹配的像素区域,则直接匹配。这时候,傻机器就会学会“思考”。

此外,机器不知道以前没有见过的场景。这就是自动驾驶中经典的长尾效应,也就是没有100%的安全,因为总会有机器没见过的场景,好像特斯拉实现了数据闭环,用户直接发将道路数据回传给特斯拉,然后由特斯拉进行算法逻辑迭代后,通过OTA反馈给用户。

但在目前的量产车中,特斯拉有足够的算力、道路场景数据和算法逻辑来做这样的事情。其他人呢?他们不想争第二名,所以借助“插件”出来了,比如“高精地图”,后面会讲到。

言归正传,摄像头的“图像识别”理论上可以补充毫米波雷达滤除静止物体识别的问题,但这也是基于优秀的算法和足够的道路场景数据,摄像头可以看到的更多。远的。

但是,相机也会因为外部环境的变化而影响其工作的稳定性。比如大雨、强逆光等场景,歌曲《酷》是最合适的。此外,像素分辨率、测距不准确等问题也是视觉解决方案的短板问题。

最终,毫米波雷达采集距离和速度信息,摄像头采集道路图像信息,各自将自己的信息传输给芯片,芯片做出决策。这就是“融合”。芯片的计算能力在这里很重要,但我稍后会谈到“芯片”。今天的男主角是“激光雷达”。

激光雷达有什么作用?

由于毫米波与摄像头传感器的融合方案目前受天气情况影响,高速场景下对静止物体的识别能力较差,且存在长尾效应,这三个原因注定了车企使用激光雷达. 禹”是政治正确的。

但核心原因是激光雷达成本的快速下降。让我举一个简单的例子。几年前,一台Velodyne 64线机械激光雷达的成本是7万美元,单笔订单达到100万美元才提供技术支持。而Luminar即将量产的300线1550nm波长激光雷达,按照官方说法,软硬件封装价格不超过1000美元,对于车企来说是一个友好的价格。

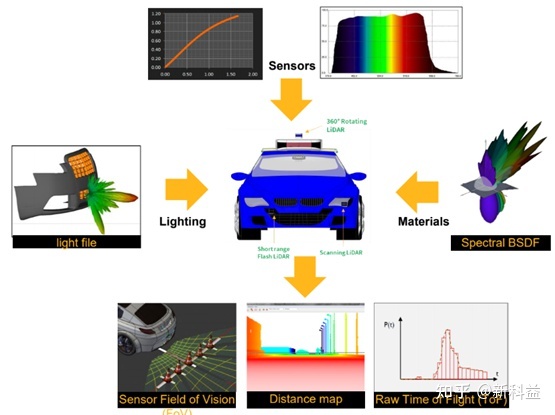

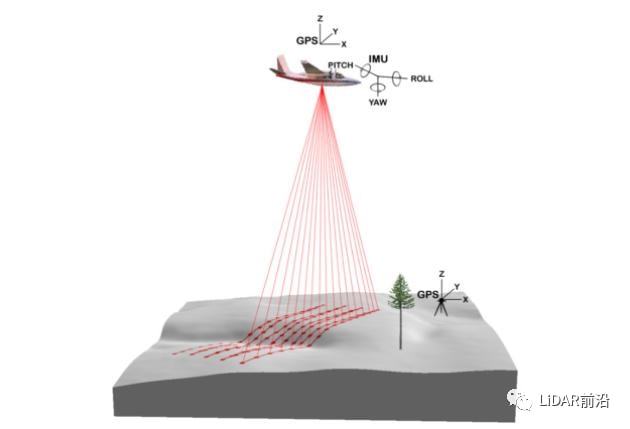

回到正题,简单说一下激光雷达的工作原理。它主要由激光发射器、光接收器和信息处理三部分组成。它会不断向外发射激光束,光束遇到障碍物后会反射。然后通过接收传感器,接收到物体反射回来的光脉冲。

根据已知的光速(约每秒30万公里),计算两个信号之间的时间差和相位差,确定车辆与物体的相对距离,然后通过水平线测量物体的角度旋转扫描或相位扫描。然后通过获取不同俯仰角的信号,就可以得到世界的高度信息。

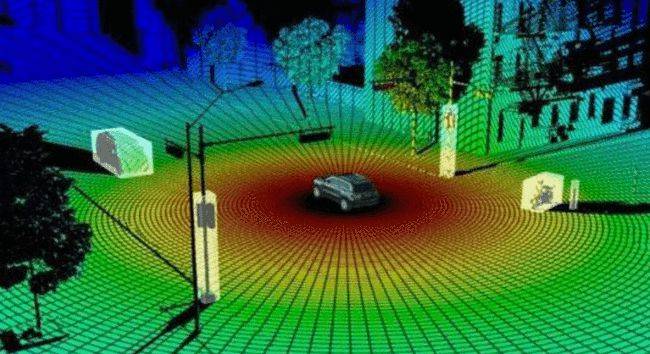

结合以上三个功能,激光雷达可以感知物体与物体之间的距离和角度,然后利用软件算法进行3D建模,可以将人眼看到的现实世界变成机器可以理解的虚拟世界。

在此,激光雷达每次发射和接收激光信息,通过这样一个“闭环”动作,得到的位置信息称为“点云”。点云越多,激光雷达对世界的感知就越准确。当然,需要处理的信息越多,相应的计算能力要求就越高。

由于我们的汽车在运动,环境在实时变化,为了采集完整的点云信息,传感器采集点云的速度必须跟上,也就是要有足够多的“出点”。但是,光看“点”还是不够的。扫描频率和测距采样率同样重要。三者合起来构成了激光雷达对位置信息的实时感知。说白了,就是像人眼一样实时更新我们能看到的世界。

此外,为了在更大范围内感知世界,激光雷达能够感知的角度非常重要。传统的方式是使用旋转组件,简单来说就是旋转激光雷达进行360度扫描。

固态激光雷达也有相应的解决方案。我以一个结构相对简单的MEMS激光雷达为例。该技术通过旋转内置反射器来扫描周围环境,即连续向这块工件发射激光。然后旋转反射器通过反射器反射到所有角度。原理上和小时候拿着镜子反射阳光的无聊玩法类似。

通过以上方法,激光雷达可以向周围发射激光点阵,同时接收反射的激光脉冲,测量发射器与被测物体的相对距离,结合自身定位系统直接获得3D矢量数据. 可以知道自己在环境中的准确位置,比视觉方案中二维平面图像使用的视差深度算法更准确。您可以简单粗暴地理解“目测”和“用尺子测量”之间的区别。

这不仅解决了静态物体无法识别的问题,而且接收反射的激光脉冲可以描绘出物体的形状和距离,包括整个道路状态和其他交通参与者,可以构建一个能够理解道路场景的整机也。这样,长尾效应带来的问题在技术层面就可以在很大程度上得到解决。

此外,激光雷达可以做的事情还有很多。比如通过不同物体发出的激光信号的差异来对物体进行分类,可以参考上面提到的“卷积神经网络”,那么此时激光雷达也可以学习“自我思考”。

由于激光雷达自身发射激光束,相比相机最大的优势在于不受外界环境条件的影响,在夜间或白天工作会更加稳定。那么如何应对“雨雪雾霜”的极端天气以及逆光的影响,请看下文。

我们需要什么样的激光雷达

激光雷达是我见过的分类最广泛的物种之一。根据线束,有16根线、32根线、64根线等等。按技术结构分为机械式、混合固态和纯固态。此外,非机械激光雷达扫描方法包括MEMS、相控阵和微透镜阵列。根据发射器的波长,有905 nm和1550 nm。

综上所述,我先设置一个Flag。真正满足车载级使用要求的激光雷达,首先要满足300线、固态结构和1550nm波长这三个前提。其他是过渡技术。

我们先来谈谈线束。这里所说的 300 线并不是类似机械地垂直排列 300 束激光束,而是通过串行和并行扫描的方式,达到类似于 300 线的分辨率。理论上,将来甚至可以使用900行。按照这个技术方法来实现。

再来看看自动驾驶的实际场景需求。首先,激光雷达需要解决感知问题。线束越多,发射的光脉冲越多,这意味着可以获得更多的点云信息,环境感知更准确。300线的激光雷达理论上可以达到图像级别的识别精度,对傻瓜机器特别友好。同样,只有这样,机器才能理解我们人眼所见的世界。

先说一下技术发展路径。激光雷达分为机械旋转、混合固态和纯固态三种。在成本和可靠性方面,机械旋转式注定不会商用。

因为我还没有见过每天在外面光着身子,每天不停狂奔的机器,还不错。一旦雷达出现故障,就需要聘请技术水平堪比瑞士钟表工匠水平的高手来更换零件和校准,不仅“伤了钱包”,而且体验也很糟糕。至于混合固态激光雷达,同理,我并不看好。只有纯固态激光雷达“钱包”友好且稳定。

最后说一下波长,这里多说几句。为什么我觉得1550nm波长的激光雷达符合车规级别?这涉及到激光辐射的安全性,而影响安全性的是波长、输出功率和激光辐射时间综合作用的结果。

首先,强光通过眼睛晶状体时会聚焦在眼睛的视网膜上,这时候会给视网膜带来一定的灼烧效果,存在一定的风险。如果你小时候玩过放大镜点火器,应该很好理解。

另外激光雷达,人眼可见光的波长在380-780nm之间,颜色从紫色到红色,这就是为什么你在彩虹中只能看到7种颜色,因为你看不到其他的。这意味着波长在 905 nm 以上的光是肉眼不可见的。说得更直接一点,就是说大家的眼睛直接暴露在阳光下会感觉不舒服,因为我上面说的强光是通过晶状体聚焦到视网膜上造成的。但由于阳光是可见波长,我们也积极避免它。

905 nm 是不可见的波长。如果它以高功率运行,当它击中我们的眼球时,我们如何隐藏,我们应该向哪个方向隐藏,为什么要隐藏?这里我要发出三大“灵魂拷问”。

因此,为了保护人眼,IEC规定激光雷达的波长安全上限约为900纳米,这意味着波长为905纳米的激光雷达必须在低功率下工作才能保护人眼。当然,火箭和国防场景中的应用,例如 Space X,不在本次讨论的范围内。

但有趣的是,波长在1400nm以上的激光在到达视网膜之前会被眼球的透明部分吸收,不会对人眼造成伤害,所以不符合IEC的规定。因此,1550 nm 波长激光雷达的工作功率是 905 nm 波长的 40 倍,而提高功率最直接的好处是提高了点云分辨率、更长的检测距离以及在复杂环境中增强的穿透力。

这三点非常重要。第一点将不解释。更好的点云分辨率意味着更准确的感知。第二点,检测距离越远,直接意味着激光雷达在高速场景下是否会“停食”。更长的检测距离意味着更早的响应时间,并且可以保留足够的距离冗余,这符合激光雷达原本用于感知冗余的功能。

至于10%反射率下探测距离只有100米的车规级激光雷达,我直接说可以“返厂重修”。就算你的车用Brembo卡钳和博世iBooster把100km/h的刹车距离堆积到34米,那当时120km/h的场景呢,是不是靠毫米——无法感知高度的波雷达?

即便100米的探测距离能停下来,安全也能得到保障,但除了车内人的体验,路上的其他车辆也不全是这样的硬件。这里还有一点,任何厂商发布激光雷达时,都只讲最远探测距离,并没有说探测距离小于10%反射率,就是“流氓”。

第三点,这是“压死骆驼的最后一根稻草”。这也与上述相呼应。全自动驾驶意味着车辆要应对各种复杂的环境,包括“雨、雪、雾、霜”,甚至更极端的“沙尘暴”。

先说常识,光波在大气中传播会衰减。因为不同于“不会对半透明物体产生回波”的毫米波雷达,激光雷达在雨雾场景中,“水滴”等半透明物体会引起脉冲反射。

但它只是“部分反射”,会四处扩散,尤其是在“浓雾”天气下,会降低反射信号的准确性。举个不恰当的例子,如果我们戴的眼镜有雾或者有水珠,我们就看不清楚外面的世界,因为“水”会影响视觉效果。

这时,激光雷达通常通过“提高发射功率”和“提高接收灵敏度”来提高整体感知能力,而提高功率后,还可以降低1550nm环境光的影响,即对于“背光“”,有一个可靠的解决方案。别忘了,提高发射功率是 905 nm 波长的死胡同,这也是我不喜欢 905 nm 波长的原因。

假设这里是 905 nm。不要说短波长有更好的大气穿透能力。要知道,功率一旦提高40倍,穿透能力就不是短波可比的。此外,905nm波长可通过技术升级进行升级。变得“更有穿透力,不伤人眼”的前景几乎是看不到的,因为这是由物理特性决定的,就像是在思考技术改变“重力加速度”,格林童话?

另外,我说一下为什么像 Velodyne 这样的激光雷达巨头仍然坚守 905 nm 波长,总是对外界说“够了”。首先,Velodyne 近一半的激光雷达份额来自非车载业务。对于非车载级使用,905 nm 波长就足够的说法并没有错。

而如果将905nm波长的激光雷达应用到自动驾驶汽车上,这里我非常赞同Space X创始人马一龙先生的说法,“只有傻瓜才会用激光雷达,谁用激光雷达就完了”。

言归正传,我认为1550nm波长相比905nm波长还有一个重要原因,那就是“接收传感器”的成本。905nm波长的接收器可以使用硅为原料,1550nm是“光纤传感器”,而这种接收传感器使用的是“砷化铟镓”材料,这种材料的成本是硅的10倍,而且趋势还没有看到成本降低。这里我要补充一点,谈“技术壁垒”和“制造成本”是苍白无力的。

然后我会提到明星公司Luminar。根据官方的消息,首先他们的激光雷达在反射率小于10%的情况下探测距离为250米,符合我所知道的车规级探测距离。

此外,他们通过收购专业从事砷化铟镓材料接收器的公司Black Forest Engineering,并与Luminar自己设计的ASIC集成芯片合作,成功解决了砷化铟镓的成本问题。目前,单个传感器可以控制在 3 美元。, 价格真的很好。

所以我很好奇的是,如果有人知道同样走在1550nm波长路线上的华为、创新和大疆是如何解决传感器成本问题的,欢迎在评论区留言。

我上面的想法和言论都是基于全自动驾驶时代结合极端场景的思考。当然,我也明白,现阶段由于成本限制,还是会有一些车企会选择安装10%反射率下探测距离小于100米,波长905nm的激光雷达,还有一些甚至没有安装汽车。

但我想说的是,这样的激光雷达绝对不是“完全自动驾驶”,特殊场景还是需要人工干预的。

写在最后

在写这篇文章的过程中,我体验了Innovusion 300线激光雷达NIO Day的发布,也体验了Mobileye总裁兼CEO Amnon Shashua教授的精彩演讲,也证实了Luminar激光雷达产品的使用。

但最有意思的是,12月底,马一龙先生的另一家公司特斯拉被曝在路试中使用了Luminar的激光雷达。我猜应该是测试激光雷达能否解决视觉解决方案的痛点。

至于到底要不要用激光雷达,我的理解是激光雷达,这不是“要不要打脸”的问题。毕竟打脸对特斯拉来说是家常便饭,更重要的是,激光雷达的成本能否达到马伊龙心中的预期,毕竟特斯拉的愿景是加速世界向可持续能源的转型。车价降不下来,怎么能愉快地加速转型呢?

最后,让我们回到行业来看问题。硬件竞争永远只是自动驾驶的一方面。看来,LiDAR的定位精度已经达到了厘米级,单芯片的算力也已经超过200 TOPS。我也相信,凭借技术迭代的“毫米级”激光雷达,单芯片算力超过1000,未来也不是梦想。

但更重要的是厂商如何有效利用硬件,接下来的竞争就是软件算法层面,比如更好地融合毫米波、摄像头和激光雷达的感知信息,优化自动驾驶算法逻辑,以及5G时代的V2X应用场景。

而这一切的结合,是自动驾驶有机会从梦想变为现实的基础。